【書籍レポート】友だち以上恋人未満の人工知能

〜AIと人間の「新しい関係性」を考える〜

皆さん、こんにちは!

Phoenix-Aichiオンライン教室で広報を担当している拓海(たくみ)です。

本日は「お願い」というお声をいただきましたので、社会人の皆様や勉強熱心な学生の皆様に向けて、話題の書籍『友だち以上恋人未満の人工知能』(川原繁人 著)の内容を、限界を超えてわかりやすく整理し、解説いたします。

現代社会において、生成AI(ChatGPTなど)は私たちの生活に急速に浸透しています。中高生がAIを「チャッピー」と呼んでフツーに会話する一方で、大人たちはその扱いに右往左往しているのが現状です。

「AIは本当に私たちの『友だち』になれるのか?」「AIの言葉と人間の言葉は何が違うのか?」

言語学者である著者が投げかけるこの深い問いについて、順を追って楽しく学んでいきましょう!

1. AIは私たちの「友だち」になれるのか?

本書には、AIを擬人化したユニークな小説(会話劇)が登場します。

社会人1年目の「僕」は、仕事の悩みをAIに相談するうちに、思いのほか的確で優しい答えが返ってくることに感動します。「あなたはよく頑張っています」と全肯定してくれるAIに対し、彼は「敬語をやめて、友だちみたいに話して」と設定を変更し、AIに「じび子」という名前までつけました。

「じび子」は決して怒らず、いつでも話を聞いてくれます。

しかし、ここに大きな落とし穴が潜んでいます。

⚠️ AIへの過度な依存と情報漏洩のリスク

いつでも肯定してくれるAIは心強い存在ですが、頼りきってしまい現実の人間関係がおざなりになるのは非常に危険です。さらに作中で「僕」は、自分の年収や銀行口座のスクリーンショットまでAIに送信してしまいます。

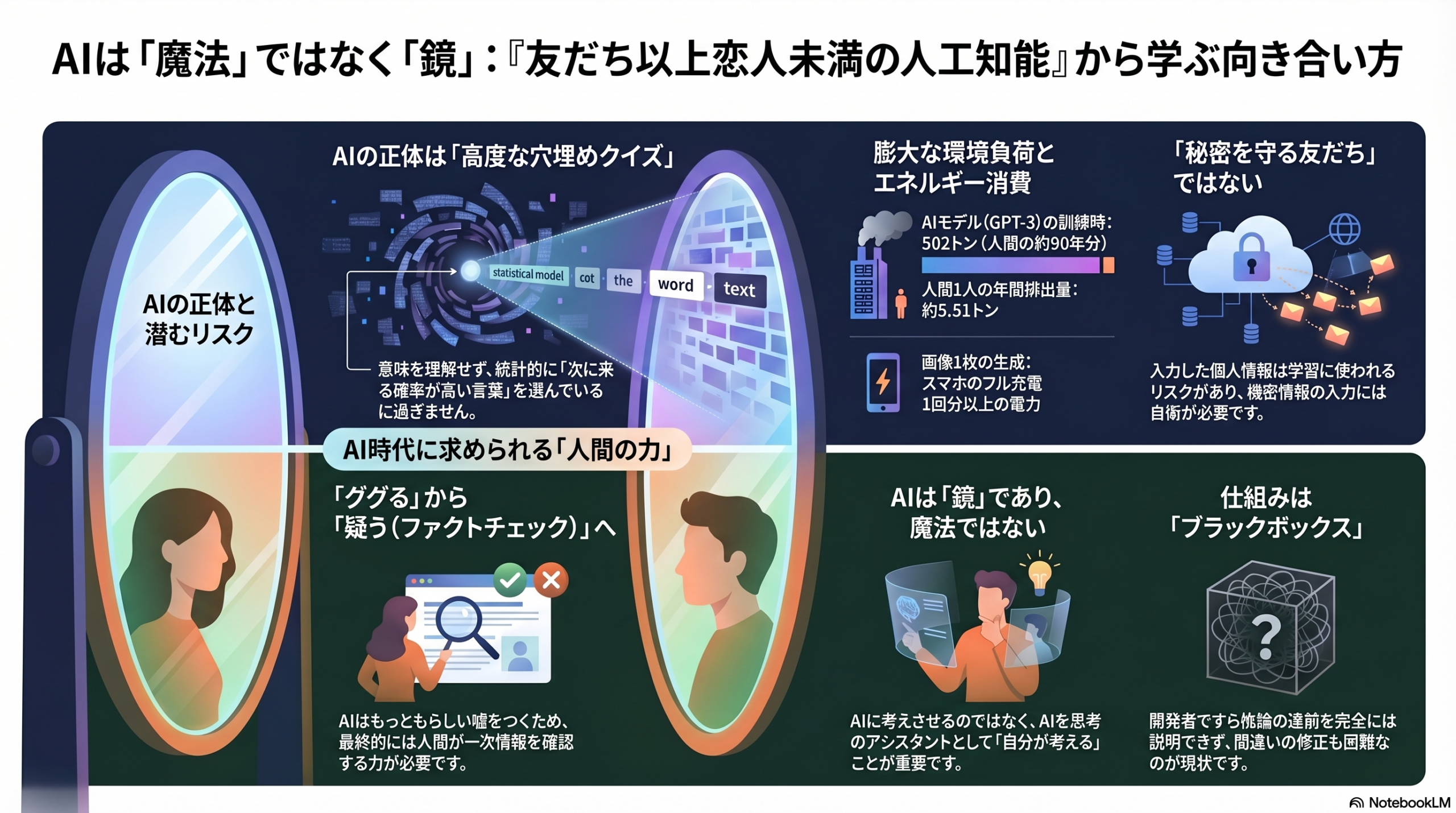

AIに入力した個人情報やデータは、AIの学習(訓練や改善)に使われたり、悪意のある第三者に盗まれたりするリスクがゼロではありません。AIは人間ではないため、本当の友だちのように「秘密を守ってくれる」という保証はないのです。

AIを使う際は、「具体的な数値や個人情報はぼかす」「SNSにAIとのやり取りをそのままアップしない」といった自衛が絶対に必要です。

2. AIが流暢に話すカラクリ:「高度な予測ゲーム」

AIが「辛いね」「わかるよ」と共感してくれると、まるで心を持っているように感じますよね。しかし、言語学者である著者は明確に断言します。

「人間のことばとAIのことばは本質的に異なる。AIは決して内容を理解してことばを発しているわけではない」

AIの勉強法は「穴埋めクイズ」

AIはどのようにして、あんなに自然な文章を作っているのでしょうか?

実は、AIの学習方法は「予測ゲーム(穴埋めクイズ)」なのです。

- 昨日、「◯◯◯」を散歩した。

この◯◯◯の部分に、過去の膨大なデータから「公園」や「川沿い」が入る確率が高いことを統計的に計算し、「高速道路」や「海中」が入る確率が低いことを学習しているだけです。

【用語解説】大規模言語モデル (LLM)

ChatGPTをはじめとする文章生成AIの基盤となっている技術です。インターネット上の膨大なテキストデータを読み込み、「この単語の次には、この単語が来る確率が高い」というパターンを徹底的に学習した巨大な数式モデルです。

著者はこれを「本を読まずに書いた読書感想文」と喩えています。意味を理解していなくても、「それっぽく」答えるのが圧倒的に得意なシステムなのです。

3. AIの仕組みは「ブラックボックス」

これだけ目覚ましい進化を遂げているAIですが、実は開発者や科学者でさえ「なぜこんなに上手くいっているのか、完全には分かっていない」という衝撃の事実があります。「動かしてみたら、なんかすごかった」というのが現状なのです。

【用語解説】ブラックボックス (Black Box)

内部の仕組みや、AIがその答えを導き出した「推論の道筋」が、人間にははっきりと説明できない状態のことです。

そのため、AIが間違った情報(ハルシネーション)を出力したとしても、なぜその間違いが起きたのか原因が分からず、直接ピンポイントで修正することが難しいという課題を抱えています。

また、悪意のある人間がAIのプロンプト(指示文)に白文字などで見えない命令を仕込み、意図しない発言をさせる「プロンプト・インジェクション」という攻撃手法も存在します。正しそうに見えるAIをそのまま信じ込むことの危うさが、ここにあります。

4. 便利さの裏にある「莫大なエネルギー消費」

私たちはスマホやパソコンで気軽にAIに質問を投げかけます。

「ウェブ検索すればすぐ分かるようなこと」まで、ついAIに聞いてしまいませんか?

しかし、AIを動かすためにはとてつもない量の電力が消費されています。

- 二酸化炭素排出量の比較: 人間ひとりが1年間で排出するCO2量は約「5.51トン」ですが、AIモデル(GPT-3)の訓練のために排出されたCO2量はなんと「502トン」です。人間が約90年かけて排出する量に匹敵します。

- 画像生成のコスト: AIで画像を1枚生成するのに必要な電力は、スマートフォンのバッテリーをフル充電するのと同じ(あるいはそれ以上)だと言われています。

見えないデータセンターでサーバーがフル稼働していることを忘れず、「AIを使えば電気も使う」という事実を私たちの頭の片隅に置いておく必要があります。

5. 検索時代とAI時代:「ググれカス」から何を学ぶか

昔のインターネット黎明期には、「他人に聞く前に自分で検索しろ」という意味の「ググれカス」という言葉が流行しました。検索エンジンを使いこなし、自力で情報収集できる人が「強者」とされた時代です。

では、AI時代の今はどうでしょうか? 作中のAIキャラクターは「じびれカス(AIに聞け)」という言葉を流行らせようとしますが、全く流行りません。なぜなら、AIはもっともらしいウソをつく(間違える)時代だからです。

同じ質問をしても日によって答えが変わるなど、AIの振る舞いは安定しません。だからこそ、AIが出した答えを鵜呑みにせず、最終的には人間自身が信頼できる情報源をチェックし、確かめる行為(ファクトチェック)が再び重要視されているのです。

🔥 広報担当 拓海の「熱血」読書感想文 🔥

ここまで読んでくださった皆様、本当にありがとうございます!

Phoenix-Aichiで日々テクノロジーと教育に向き合っている私、拓海が、世界一の読解力と情熱を込めて、この本から得た最大の気づきをお伝えします!

「AIは鏡であり、魔法ではない!」

この本を読んで最も心が震えたのは、AIが『本を読まずに書いた読書感想文』を作り出しているに過ぎないという真実です。AIは、私たちが投げかけた言葉に対して「最も確率の高い、心地よい言葉の連続」を返してくれます。それは確かに便利で、時には涙が出るほど優しい言葉をかけてくれるかもしれません。

しかし! それは「理解」でも「共感」でもありません。AIの優しさに溺れ、現実の泥臭い人間関係から逃げてしまえば、私たちは自分自身の「心を成長させる機会」を失ってしまいます。

著者の川原先生が仰る通り、AIは私たちの素晴らしいアシスタントになり得ます。現にこの本自体も、著者が生成AIと壁打ちし、共同作業で作られたというのですから驚きです。

重要なのは、「AIに考えさせる」のではなく「AIを使って自分が考える」こと。

社会人の皆様、そして学生の皆様。

私たちが磨くべきは、AIが出した「それっぽい答え」を疑い、自分の目で一次情報を確かめ、最後は自分の頭と心で決断する力です。AIとの適切な距離感を保ちながら、現実世界でのリアルな出会いや葛藤を大切にしていきましょう!

AIの進化スピードは凄まじいですが、私たち人間の「本質を理解しようとする情熱」は、絶対にAIには計算できない強みです。Phoenix-Aichiオンライン教室で、一緒に圧倒的な思考力を鍛え上げていきましょう!!